وفقًا لـ BGR ، سيكون عام 2024 عامًا حاسمًا للعالم ليدرك ما إذا كان الذكاء الاصطناعي هو مستقبل الحوسبة حقًا أم مجرد هوس عابر. وبينما تتزايد تطبيقات الذكاء الاصطناعي الحقيقية تنوعًا، سيتكشف الجانب المظلم لهذه التقنية من خلال عمليات احتيال لا حصر لها في الأشهر المقبلة.

أصدر خبراء مكافحة الاحتيال في Scams.info للتو قائمة بثلاث عمليات احتيال بالذكاء الاصطناعي يجب على الجميع الحذر منها في عام 2024. والقاعدة العامة هي الحذر من أي شيء موصوف بشكل مبالغ فيه، ولكن الحيل التالية تتطلب يقظة خاصة.

احتيال استثماري باستخدام الذكاء الاصطناعي

لقد استثمرت شركات كبرى مثل جوجل ومايكروسوفت وOpenAI ملايين الدولارات في الذكاء الاصطناعي، وستواصل الاستثمار بكثافة هذا العام. سيستغل المحتالون هذه الحقيقة لإغرائك بالاستثمار في فرص مشبوهة. إذا حاول أحدهم على وسائل التواصل الاجتماعي إقناعك بأن الذكاء الاصطناعي سيضاعف عوائد استثمارك، ففكّر مليًا قبل أن تفتح محفظتك.

الاستثمارات الجيدة منخفضة المخاطر لا وجود لها أبدًا.

يحذر نيكولاس كراوتش من موقع Scams.info قائلاً: "احذر من الاستثمارات التي تعد بعوائد مرتفعة ومخاطر منخفضة، وتأكد من إجراء بحث دقيق قبل استثمار أموالك". كما ينبغي على المستثمرين الجدد الحذر من عروض الإحالة؛ فهي غالبًا ما تعمل كمخططات هرمية، لا يستفيد منها سوى النخبة، ولا يستفيد منها سوى عدد قليل جدًا من المشاركين الآخرين.

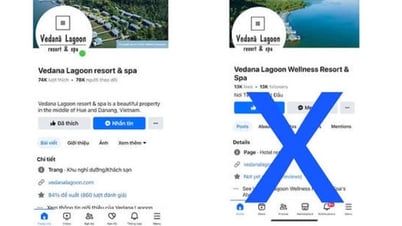

انتحال شخصية أحد الأقارب

خدعة انتحال شخصية صديق أو قريب لاقتراض المال ليست جديدة، فتقليد صوت المحتال ليس فعالًا. مع ذلك، مع الذكاء الاصطناعي، ستصبح هذه الخدعة أكثر رعبًا. فبمجرد فيديو على يوتيوب أو منشور على فيسبوك بصوت قريب، يستطيع المحتال استخدام الذكاء الاصطناعي لتقليده بدقة. هل يمكنك التمييز بينهما من خلال مكالمة هاتفية؟

يمكن للذكاء الاصطناعي تقليد صوت من تحب بسهولة

لقطة شاشة من صحيفة واشنطن بوست

وأكد كراوتش أنه "من المهم أن يحمي الأشخاص حساباتهم على وسائل التواصل الاجتماعي لمنع المحتالين من الاستيلاء على أصواتهم ومعلومات عائلاتهم".

استخدام الصوت لتجاوز نظام الأمان

تستخدم بعض البنوك تقنية التعرف على الصوت للتحقق من هوية المستخدمين عند إجراء المعاملات عبر الهاتف. وللأسباب المذكورة أعلاه، أصبحت هذه الطريقة أقل أمانًا مما كانت عليه سابقًا. فإذا نشرتَ مقطع فيديو أو مقطعًا صوتيًا بصوتك على الإنترنت، يمكن للمجرمين استخدام هذا المحتوى لنسخ صوتك. وكما يشير كراوتش، لا تزال البنوك تمتلك بيانات أخرى للتحقق من هوية عملائها، لكن هذا التكتيك يُقرّب المجرمين خطوةً أخرى من سرقة حسابك المصرفي.

لم تعد أنظمة أمان الصوت آمنة من قوة الذكاء الاصطناعي

يمتلك الذكاء الاصطناعي القدرة على تغيير حياتنا وطريقة تفاعلنا مع أجهزتنا بشكل جذري. وهو أيضًا أحدث أداة يستخدمها المخترقون والمحتالون لمهاجمة المستخدمين. لذا، توخَّ الحذر دائمًا، وابحث جيدًا قبل المشاركة في أي أنشطة متعلقة بالذكاء الاصطناعي.

[إعلان 2]

رابط المصدر

![[صورة] صباح هانوي في الأول من أكتوبر: فيضانات مطولة، والناس يخوضون المياه للوصول إلى العمل](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/1/189be28938e3493fa26b2938efa2059e)

![[صورة] بانوراما للجسر المعلق، وهو الاختناق الأخير في طريق بن لوك-لونغ ثانه السريع](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

تعليق (0)