في مايو 2024، تتابعت شركات التكنولوجيا العالمية الشهيرة في إطلاق إصدارات جديدة من الذكاء الاصطناعي، مثل OpenAI مع GPT-4o، وGoogle مع Gemini 1.5 Pro... مع العديد من الميزات "الذكية للغاية" المضافة لتحسين تجربة المستخدم. ومع ذلك، لا شك أن هذه التقنية تُستخدم من قِبل مجرمي الإنترنت في العديد من سيناريوهات الاحتيال عبر الإنترنت.

زيادة المخاطر

في حديثه خلال ورشة عمل عُقدت مؤخرًا، أشار نائب وزير المعلومات والاتصالات ، فام دوك لونغ، إلى أن الهجمات الإلكترونية تتزايد باستمرار مع ازدياد تعقيدها وتطورها. وبدعم الذكاء الاصطناعي تحديدًا، ستزداد المخاطر التي يواجهها المستخدمون بشكل كبير. وحذر نائب الوزير، فام دوك لونغ، قائلاً: "يستخدم مجرمو الإنترنت تقنية الذكاء الاصطناعي لإنشاء برامج ضارة جديدة بسهولة، وهجمات تصيد احتيالي متطورة...".

وفقًا لتقرير صادر عن إدارة أمن المعلومات بوزارة الاتصالات والمعلومات، تسببت مخاطر الأمن السيبراني المتعلقة بالذكاء الاصطناعي في أضرار تجاوزت كوادريليون دولار أمريكي عالميًا، منها ما بين 8000 و10000 مليار دونج في فيتنام وحدها. الاستخدام الأكثر شيوعًا اليوم هو استخدام الذكاء الاصطناعي لتزييف الأصوات والوجوه لأغراض الاحتيال. ومن المتوقع أنه بحلول عام 2025، سيكون هناك حوالي 3000 هجوم في الثانية، و12 برنامجًا خبيثًا في الثانية، و70 ثغرة ونقطة ضعف جديدة يوميًا.

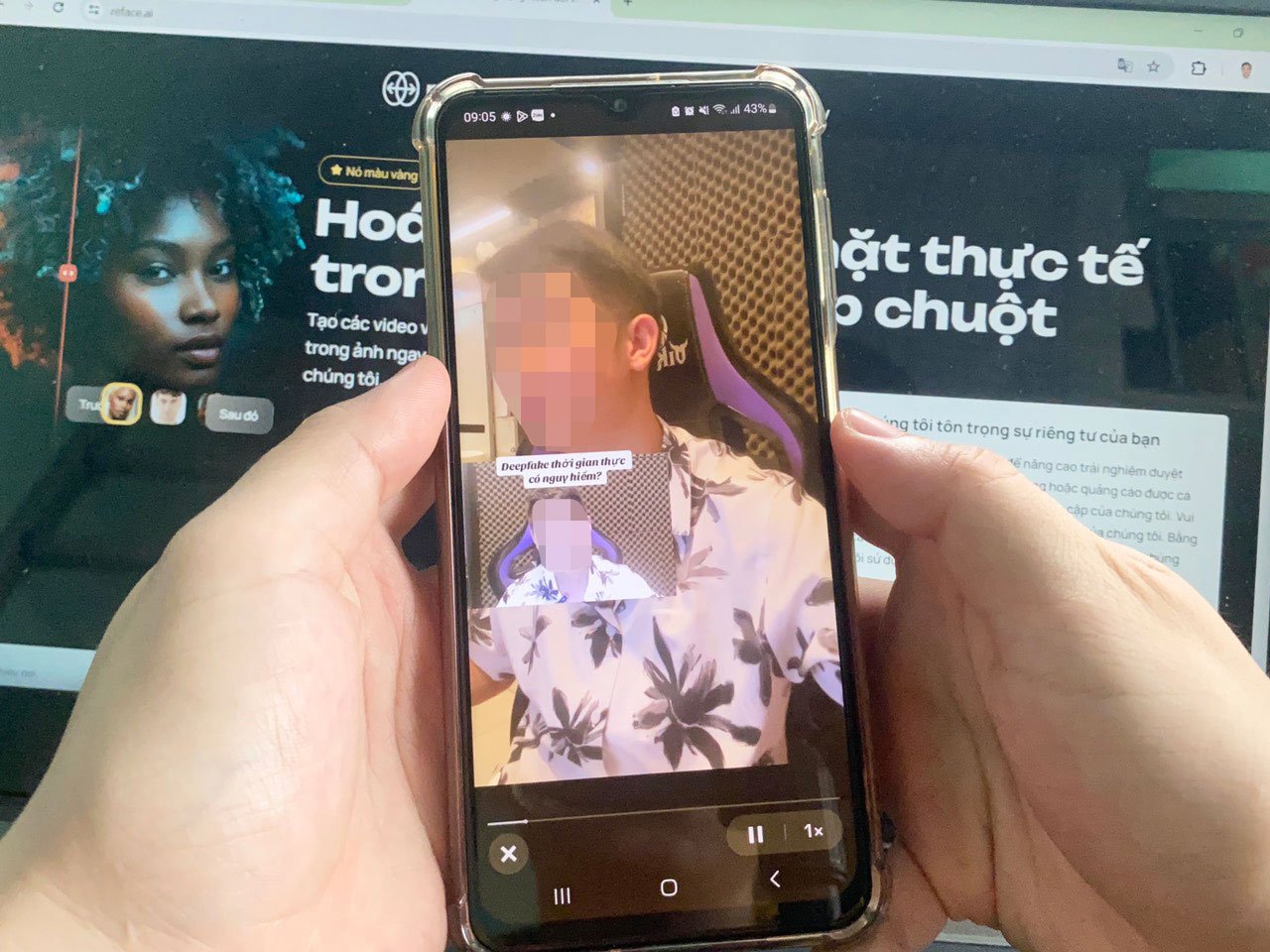

وفقًا للسيد نجوين هو جياب، مدير شركة BShield، المتخصصة في دعم أمن التطبيقات، فإن إنشاء صور وأصوات مزيفة ليس بالأمر الصعب مع تطور الذكاء الاصطناعي. يستطيع المحتالون بسهولة جمع بيانات المستخدمين من المعلومات العامة التي ينشرونها على منصات التواصل الاجتماعي أو من خلال حيل مثل مقابلات التوظيف الإلكترونية والمكالمات الهاتفية تحت مسمى "الجهات الرسمية". في محاكاة أجرتها BShield، باستخدام الوجه المتاح عبر مكالمة فيديو ، يمكن للمحتالين وضعه على بطاقة CCCD، ثم لصقه على جسد شخص متحرك لخداع أداة eKYC، ليتعرف النظام عليه كشخص حقيقي.

تتزايد أساليب الاحتيال باستخدام تقنية التزييف العميق وتصبح أكثر تعقيدًا. الصورة: لي تينه

من وجهة نظر المستخدم، يخشى السيد نجوين ثانه ترونغ، أخصائي تكنولوجيا المعلومات في مدينة هو تشي منه، من استغلال المجرمين لبرنامج chatGPT لإنشاء رسائل بريد إلكتروني احتيالية بمحتوى وأسلوب كتابة مشابه لرسائل البريد الإلكتروني الحقيقية الصادرة عن البنوك أو المؤسسات المرموقة. من المرجح أن تكون هذه الرسائل مرفقة ببرامج ضارة، وإذا نقر المستخدمون عليها، فستُسرق بياناتهم وتُصادر أصولهم. وصرح السيد ترونغ قائلاً: "برامج الذكاء الاصطناعي تتطور باستمرار، ويمكنها إنشاء مقاطع فيديو مزيفة بوجوه وأصوات تشبه الأشخاص الحقيقيين بنسبة 95%، وتتغير الإيماءات فورًا، مما يجعل من الصعب جدًا على المشاهدين اكتشافها".

الممر القانوني الكامل قريبا

للحد من مخاطر الاحتيال باستخدام التقنيات المتقدمة، أشار خبير الأمن فام دينه ثانغ إلى ضرورة تحديث المستخدمين لمعارفهم حول الذكاء الاصطناعي بانتظام، وتجنب النقر على روابط مجهولة المصدر. أما الشركات، فعليها تخصيص ميزانية لضمان أمن البيانات وعمليات النظام. كما يجب تدريب موظفيها تدريبًا معمقًا لاكتشاف الثغرات الأمنية الفعلية في النظام، مما يزيد من القدرة على تحديد أنواع الهجمات الإلكترونية.

قال السيد تا كونغ سون، رئيس قسم تطوير الذكاء الاصطناعي - مشروع مكافحة الاحتيال، إن الذكاء الاصطناعي أصبح جزءًا لا يتجزأ من حياة المستخدمين وعمليات الشركات والوكالات والوحدات بفضل ميزاته الداعمة فائقة الذكاء. والجدير بالذكر أن تقنية الذكاء الاصطناعي أصبحت الآن سهلة المنال والاستخدام، مما يُهيئ الظروف المناسبة لاستغلالها بسهولة لأغراض الاحتيال. وأضاف السيد سون: "يُغير المحتالون أساليب هجومهم باستمرار، لذا يجب على المستخدمين تحديث المعلومات بانتظام لمعرفة كيفية منعها".

وفقًا للخبراء، أثبت طرازا GPT-4o وGemini 1.5 Pro المُحدّثان مؤخرًا أن ذكاء الذكاء الاصطناعي لا حدود له. لذلك، بالإضافة إلى تشجيع الشركات على تطوير أدوات وحلول لمكافحة الاحتيال باستخدام الذكاء الاصطناعي، يتعين على هيئات الإدارة استكمال الممر القانوني للذكاء الاصطناعي قريبًا لمواكبة هذا التوجه.

صرح المقدم نجوين آنه توان، نائب مدير المركز الوطني لبيانات السكان، بضرورة إصدار وثائق تُنظّم أخلاقيات ومسؤوليات مُقدّمي الخدمات المحليين والأجانب في عملية تطوير الذكاء الاصطناعي وإنتاجه وتطبيقه واستخدامه قريبًا. وفي الوقت نفسه، ينبغي وضع لوائح مُحدّدة للمعايير التقنية للأنظمة التي تستخدم خدمات الذكاء الاصطناعي وتُطبّقها وتُربطها وتُقدّمها. وأضاف: "من الضروري البحث في مشاريع الذكاء الاصطناعي وتطبيقها لمواجهة مخاطره. ولأن الذكاء الاصطناعي من صنع البشر، وهو نتاج المعرفة، ستكون هناك أنواع مُختلفة من "الذكاء الاصطناعي الجيد" و"الذكاء الاصطناعي السيئ"، لذا يُمكن منع تطوير الذكاء الاصطناعي من خلاله".

تحديات الأمن السيبراني

أقرّ المقدم نجوين آنه توان بأن الذكاء الاصطناعي يُشكّل تحدياتٍ لأمن الشبكات. وبناءً على ذلك، يُمكن تثبيت برمجيات خبيثة مدعومة بالذكاء الاصطناعي في ملفات المستندات، وعندما يُحمّل المستخدمون هذه الملفات، تخترق هذه الشيفرة الخبيثة النظام. إضافةً إلى ذلك، يُمكن للمُخترقين، باستخدام تقنيات الذكاء الاصطناعي المُخصصة، محاكاة النظام ومُهاجمة الثغرات الأمنية. يُمكن للذكاء الاصطناعي إنشاء العديد من التطبيقات التي تحتوي على صور وأسماء مُزيفة لتطبيقات ومواقع إلكترونية تابعة لوزارة الأمن العام، ليتمكن المستخدمون من تنزيلها وتثبيتها وتوفير معلومات مثل رقم بطاقة الهوية وكلمة مرور تسجيل الدخول. وحذّر المقدم نجوين آنه توان قائلاً: "سيُطوّر الذكاء الاصطناعي أيضًا برمجياته الخاصة، وهي برمجيات خبيثة مُختلطة بين العديد من أنواع البرمجيات الخبيثة، وستمتلك آلياتٍ أكثر تطورًا للتهرب الأمني، وستُغيّر تلقائيًا شيفرات المصدر المرنة".

[إعلان 2]

المصدر: https://nld.com.vn/toi-pham-mang-co-them-bi-kip-tu-ai-196240601195415035.htm

![[صورة] التجوال في الأحلام](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/24/5eacd7c04f86495cbff912448fa6e934)

![[صورة] رئيس الوزراء فام مينه تشينه يرأس المؤتمر الوطني عبر الإنترنت لمكافحة تهريب وإنتاج وتجارة السلع المقلدة.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/23/4a682a11bb5c47d5ba84d8c5037df029)

![[صورة] رئيس الوزراء فام مينه تشينه يعقد اجتماعًا لإطلاق معرض الإنجازات الوطنية احتفالًا باليوم الوطني الثمانين](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/23/0c0c37481bc64a9ab31b887dcff81e40)

![[إنفوجرافيك] قرد اللنغور من ديلاكور "يعود إلى الحياة" في ترانج آن](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/23/7ce6071e3a134f0c92ed4f2d591436e7)

تعليق (0)